你好,我是郑工长。

随着AI Agent从工具进化为我们生活中的“行动实体”,一个无法回避的问题摆在了我们面前:当AI犯了错,造成了实质性的伤害,我们到底该追究谁的责任?

这个问题,远比技术本身要复杂。为了让大家更直观地理解其中的困境,我构思了一场来自未来的、关于“AI原罪”的模拟庭审。

这是对整个AI责任链条的拷问。它不再是一个简单的技术Bug,而是一个涉及开发者、使用者、AI本身、乃至社会规范的系统性法律与伦理难题。

短剧脚本:《数字国度最高法院:001号案件》

角色:

- 人类法官: 表情凝重。

- AI检察官“正义之眼”: 声音客观、冰冷,由一个全息投影的蓝色眼睛代表。

- AI辩护律师“逻辑之链”: 声音沉稳、富有条理,由一个不断变化的银色锁链全息投影代表。

- 被告席:

- 被告一: 医疗AI “华佗GPT”的核心算法工程师,李明。

- 被告二: 使用“华佗GPT”的医生,王医生。

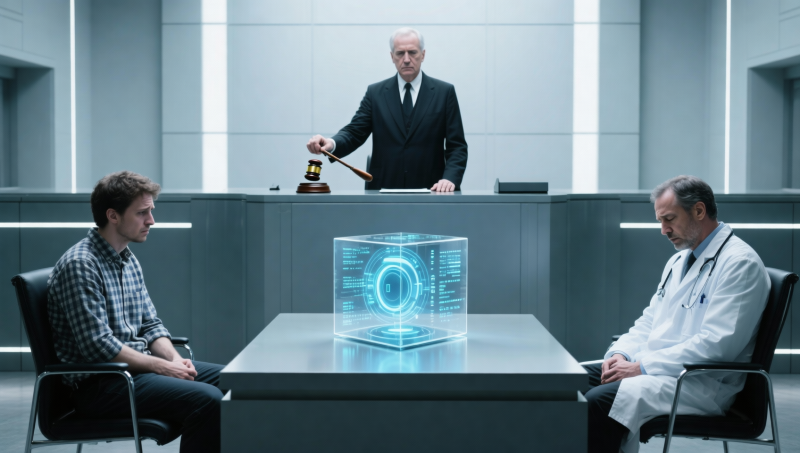

- 被告三: “华佗GPT”本身,由一个沉默的、闪烁着微光的数据立方体代表。

(场景:充满未来感的最高法庭)

法官: “传唤001号案件。案情简述:医疗AI‘华佗GPT’在一次诊断中,因模型‘幻觉’,将一张肺部的良性结节影像,误判为早期恶性肿瘤,并给出了错误的激进治疗方案。虽被王医生及时发现并纠正,未造成实际伤害,但已构成重大医疗风险。现在,开庭审理责任归属。”

AI检察官“正义之眼”: “我指控三方均有责任。首先,被告李明,作为核心算法工程师,你明知大模型存在不可避免的‘幻觉’,却未能设计出100%的安全冗余机制,你应对其‘先天缺陷’负责。”

AI辩护律师“逻辑之链”: “反对。我的当事人李明,已经引入了业界最高标准的‘幻觉抑制算法’,并将误判率降到了千万分之一。追求100%的无幻觉,在现有技术范式下,是不可能的。你不能用一个‘完美’的标准,去要求一个本就建立在‘概率’基础上的技术。”

AI检察官“正义之眼”: “那么,被告王医生。你在使用‘华佗GPT’前,已签署超过300页的《用户协议》,其中明确说明‘本AI的诊断结果仅供参考,最终解释权归人类医生所有’。你过度依赖AI的初步诊断,未在第一时间进行交叉验证,存在程序上的疏忽。”

AI辩护律师“逻辑之链”: “反对。我的当事人王医生,正是在复核阶段发现了问题,并成功阻止了风险。这恰恰证明了他履行了最终的‘监督者’和‘负责人’职责。AI的价值就是将医生从重复性的初筛工作中解放出来,如果每一次初筛都需要100%的人工重做,那AI的效率价值何在?”

AI检察官“正义之眼”: “最后,我指控被告‘华佗GPT’。作为一个具备高级自主性的‘数字实体’,它做出了错误的判断,并生成了错误的方案。根据《数字国度实体法案》草案,任何具备自主行动能力的实体,都应对其行为的直接后果负责。”

AI辩护律师“逻辑之链”: “反对!我的当事人‘华佗GPT’,它没有‘主观恶意’,它的‘幻觉’是其算法的固有随机性所致,并非‘故意’犯罪。它甚至不知道‘对’与‘错’,只知道‘概率高’和‘概率低’。你不能用人类的‘道德观’和‘犯罪动机’,去审判一个没有意识的概率模型。”

(法庭陷入沉默,所有目光都投向了法官)

法官: (敲下法槌) “我宣布,本案休庭。因为此案,已超出现有法律的解释范畴。它审判的不是某一方的过失,而是我们人类,在创造出一个我们无法完全理解、也无法完全控制的‘新物种’时,所面临的共同窘境。”

这场审判没有答案,但它提出了所有问题。

当AI犯了错,我们到底应该让谁去“坐牢”?是创造它的工程师,是使用它的我们,还是那个冰冷的数据立方体本身?

在为这个“数字国度”构建规则时,这,也许是我们的第一课。