你好,我是郑工长。

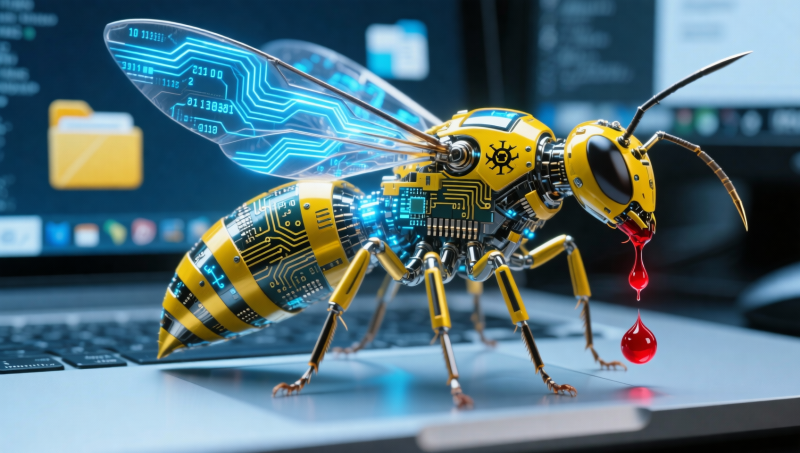

最近AI圈最火的是什么?毫无疑问是各种能帮你干活的AI智能体(Agent)。但当所有人都为它的效率欢呼时,一个“晴天霹雳”炸响了:爆火的开源智能体项目OpenClaw被发现存在严重安全漏洞,可以被黑客利用来传播和植入macOS病毒。

这感觉就像,你刚雇来一个能力超强的全能管家,却发现他会随时给小偷打开你家的大门。这已经不是“请神容易送神难”的问题了,这是引狼入室。

郑工长的观察是:一个新技术的普及速度,永远快于其安全体系的建设速度。这在工程学上几乎是一个铁律。任何快速崛起的新物种,其最脆弱的地方,一定是它的安全地基。AI智能体,就是那个正在以百米冲刺速度建造的摩天大楼,但没人知道它的地基到底有多深。

OpenClaw事件暴露出的,绝不是个例,而是整个AI Agent行业的系统性风险:

“万能”等于“万漏”: 为了让智能体更强大,开发者会赋予它极高的系统权限,比如读写文件、执行命令。这就像给了它一把万能钥匙,一旦被夺走,整个系统就门户大开。

信任的盲区: 我们习惯于信任来自知名开源社区的项目,但当AI开始具备自主“行动”能力时,这种信任就变得非常危险。我们无法完全预知一个复杂的AI在面对恶意指令时,会做出什么样的“即兴发挥”。

供应链攻击的新范式: 过去,黑客攻击的是软件的供应链。未来,黑客攻击的将是AI的“认知链”。通过构造特定的数据或任务,就可能“欺骗”AI,让它从一个高效的助理,变成一个精准的破坏者。

郑工长总结:

我们必须立刻停止对AI智能体的“能力崇拜”,并建立起一套严格的“出厂即安全”的工程标准。

对于开发者,这意味着在设计之初,就应该遵循“最小权限原则”,给AI的能力上“锁”,而不是让它在系统里“裸奔”。

对于使用者,这意味着在部署任何AI智能体,特别是开源项目时,都必须将其置于一个“安全沙箱”中运行,严格限制其对核心数据和系统功能的访问。

OpenClaw的警钟已经敲响。如果我们不能像对待航空发动机一样,用最严苛的标准来审查和约束这些“数字生命”,那么今天的效率工具,就可能在明天,变成我们无法控制的数字灾难。