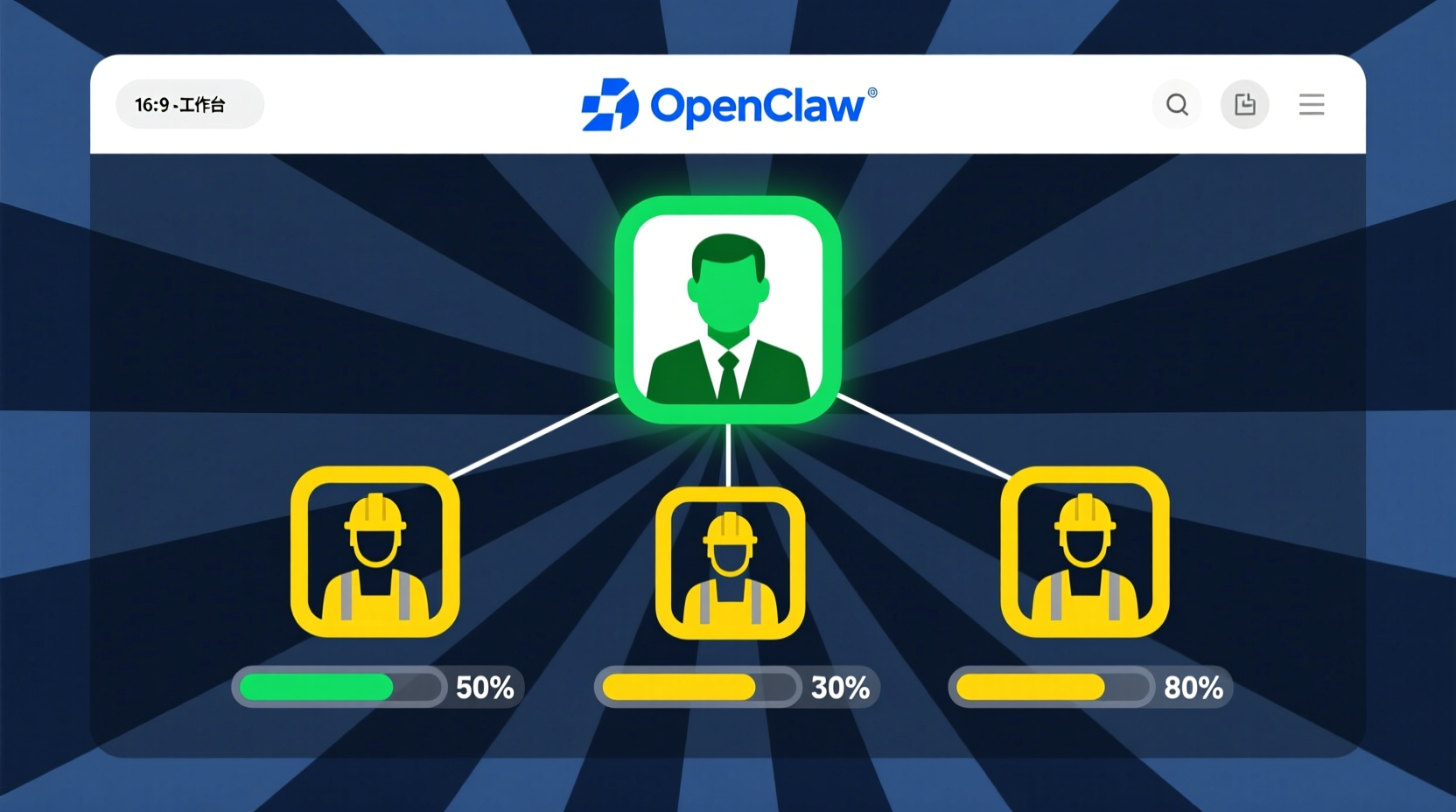

你好,我是郑工长。

昨天有个粉丝火急火燎找我,说部署的 OpenClaw 像个废铁,联网搜索全超时,服务隔三差五就崩。我让他把配置单发过来,扫了一眼就明白了——典型的"省钱省到坑里去了"。

服务器选的是华北地域,内存配了 1GiB。说白了,这是在用跑静态网页的思路去部署 AI 辅助工具。这种配置,能跑通才是运气,跑不通才是常态。

我见过太多人在基础设施上抠搜,最后花在排查问题上的时间成本,够买几十台高配服务器了。今天就把这话放这儿,OpenClaw 部署有两个死穴,踩中任何一个,你的 AI Coding 体验直接归零。

死穴一:国内地域是个"逻辑死胡同"

很多人觉得,服务器选离自己近的就行,人在国内就选华东华北,延迟低,访问快。这个逻辑放在传统 Web 服务上没问题,但用在依赖全球开源生态的 AI 工具上,就是刻舟求剑。

这背后,是网络路由与资源可达性的问题。

OpenClaw 的核心能力依赖于联网搜索、模型调用以及代码库的实时拉取。国内地域的服务器, outbound 流量(出站流量)受到严格的管理策略限制。你访问 GitHub 可能慢,调用某些海外 API 可能直接超时,DNS 解析也可能被污染。

选国内地域,等于给你的 AI 工具戴上了镣铐跳舞。你以为省了带宽钱,实际上你牺牲的是工具的"鲁棒性"。

我见过太多案例,部署在国内,日志里全是 Connection Timeout 或者 DNS Resolution Failed。新手这时候容易怀疑是代码写错了,开始疯狂调试应用层逻辑。等等,事情没这么简单。 根子上是网络链路不通。你应用层代码写得再漂亮,网络层不通,一切白搭。

反过来想,香港或美国弗吉尼亚地域,虽然物理 ping 值高了几十毫秒,但它们处于全球互联网的核心节点,访问开源社区、API 服务的连通性是原生级的。对于 AI 工具来说,连通性远比那几十毫秒的延迟重要。

死穴二:内存小于 2GiB,就是在玩火

再看内存配置,1GiB 想跑 AI 辅助服务?懂我意思吗? 这不是省成本,这是在埋雷。

从第一性原理来看,现代 AI 辅助工具通常基于容器化部署,里面可能跑着 Java 运行时、Node 服务,甚至是轻量级的向量检索进程。这些组件本身就有基础内存开销。

- 容器守护进程:吃掉 100-200MB

- 运行时环境(JVM/Node):预热至少需要 500MB+

- 业务逻辑缓存:动态分配

你配 1GiB,相当于让一个成年人住进儿童床,转身都难。一旦并发稍微上来,或者处理一个稍大的代码上下文,内存瞬间打满。这时候操作系统的 OOM Killer(内存溢出杀手)会直接介入,杀掉你的服务进程。

内存配置不是看"能不能启动",而是看"高负载下会不会崩"。

服务频繁重启,不仅影响体验,还会导致数据写入中断、会话状态丢失。这种不稳定因素,对于需要连续上下文的 AI Coding 来说,是致命的。你正写着一半,后端服务挂了,这种挫败感会直接摧毁你对工具的信任。

正确姿势:地域与配置的"黄金组合"

别搞错了,部署不是抽奖,是有标准答案的。基于我过去的交付经验,以下是经过验证的"黄金组合",直接抄作业就行。

1. 地域选择:香港 或 美国弗吉尼亚

- 香港:适合主要用户在亚洲,需要兼顾国内访问速度(虽然会有波动,但连通性优于内地)。

- 美国弗吉尼亚:适合追求极致连通性,且能接受稍高网络延迟的场景。这里是全球云服务最密集的区域,生态兼容性最好。

2. 内存配置:起步 2GiB,推荐 4GiB

- 2GiB:最低底线。能保证服务稳定运行,不轻易触发 OOM。

- 4GiB:推荐配置。留有余量,应对突发流量或复杂任务,系统更从容。

划重点,CPU 倒是可以适度放宽,比如 1 核或 2 核,但内存绝对不能省。内存是硬资源,CPU 是计算力,AI 工具大部分时间在等待 I/O,内存瓶颈比 CPU 瓶颈更早出现。

部署完怎么验货?

配置选对了,怎么知道真的没问题?别光看服务状态是 Running,那只是表象。你要做压力测试和连通性验证。

第一步:检查外网连通性

进入容器内部,执行 curl -v https://api.openai.com 或者你依赖的其他核心 API 地址。如果能迅速返回 HTTP 状态码,说明网络链路通畅。如果一直卡在 Connecting,那就是地域选错了。

第二步:监控内存水位

观察运行半小时后的内存使用率。如果长期维持在 80% 以上,说明配置刚够底线,建议升级。如果频繁出现 Killed 日志,必须立刻加内存。

第三步:实战测试

让它执行一个需要联网搜索的复杂任务,比如"查询最新的 Python 库并生成示例代码"。观察响应时间和成功率。如果超时,检查日志是网络层错误还是应用层错误。

基础设施不打折,体验才不会打折

最后我想说,很多新手容易陷入一个误区,觉得软件是虚拟的,所以跑软件的资源也可以虚拟着来。归根结底,代码是跑在物理资源上的,物理规律不会因为你是 AI 项目就网开一面。

在数字化工程里,稳定性是设计出来的,不是调试出来的。你在选址和配置上多花的那点钱,买的是确定性,买的是你后续几个月不被莫名其妙 bug 困扰的安心。

真正的省钱,是一次性把基础打牢,避免反复返工。

别为了省一杯咖啡钱,让整个工程队陪你加班修路。时间会证明,在基础设施上投入的每一分钱,都会在未来的稳定性中加倍回报给你。