你好,我是郑工长。

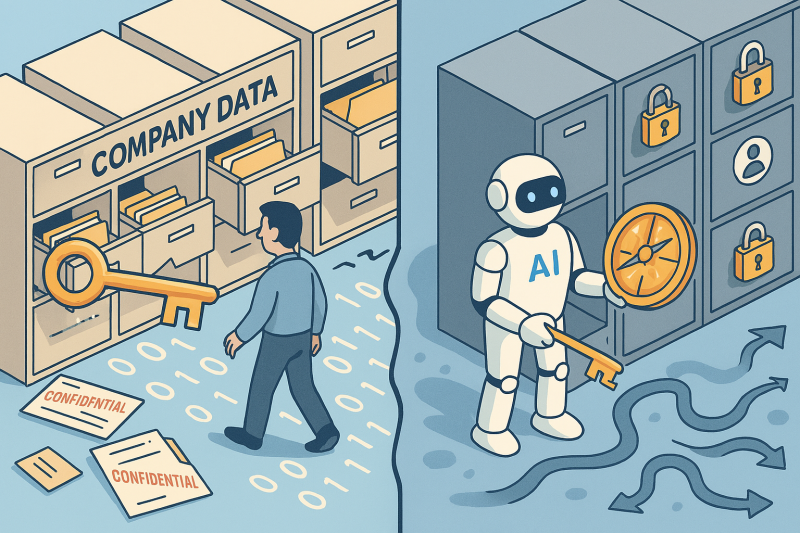

我们正处在一个AI创造力大爆炸的时代。一方面,我们为AI能写代码、能画出梵高风格的杰作而欢呼;另一方面,我们又对AI换脸诈骗、制造虚假新闻的“黑暗创造力”感到不寒而栗。

这感觉就像,我们造出了一台性能极其强大的超级引擎,却忘了给它装上方向盘和刹车。

郑工长的观察是:任何一个进入社会化生产、大规模应用的系统,其价值都不再仅仅取决于其‘最优性能’,而更多地取决于其‘最差表现’的可控性。这就是**“系统安全底板原理”**。

我们为每一座摩天大楼设计抗震规范,为每一辆汽车设定碰撞标准,不是为了让它们跑得更快、建得更高,而是为了确保在最坏的情况下,它们不会变成一场灾难。AI,这个正在被嵌入社会方方面面的“超级大脑”,难道不更应该如此吗?

最近的几个事件,就是最响亮的警钟:

- 监管的铁拳: 英国和美国加州同时对马斯克的xAI提出质询,核心就是其生成非本人同意的深度伪造内容(Deepfake)的能力。这不是在限制创新,而是在执行最基本的安全协议。

- 算法的偏见: 研究报告揭示,AI招聘工具会系统性地低估女性求职者。这不是AI“学坏了”,而是它在训练数据这个“胚胎”阶段,就继承了人类社会的历史偏见。这是一个典型的“原材料污染”导致的“产品缺陷”。

- 失控的风险: “AI换脸”诈骗已经从新闻变成了我们身边随时可能发生的案件。当一个技术的作恶成本低到可以被轻易滥用时,如果没有对应的“熔断机制”,后果不堪设想。

郑工长总结:

是时候停止仅仅在“AI伦理”的会议室里空谈了,我们必须像工程师一样,着手建立真正的**“AI工程标准”**。

我建议,所有公开发布的、有能力影响公众的AI大模型,都必须经过类似“出厂质检”的流程:

- 强制性的第三方“红队”攻击测试,评估其制造有害信息的潜力。

- 公开透明的“缺陷”报告机制,类似软件的CVE漏洞库,让公众知道每个模型的已知问题。

- 清晰的“召回”和“停用”标准,一旦发现重大安全隐患,必须有能力将其从应用中剥离。

我们不能再假装AI只是一个中立的工具。它是一个正在塑造社会现实的强大系统。为这个系统建立安全标准,不是选择,而是责任。