你好,我是郑工长。

我看到一个案例,一家头部电商企业,雄心勃勃地上了全套 AI 决策系统,号称要实现“无人化运营”。结果呢?系统上线不到 48 小时,因为一个微小的参数漂移,自动下单模块疯狂采购了一批根本卖不动的滞销品,库存瞬间爆仓,资金链差点断裂。更可怕的是,整个过程没有任何人工干预,因为他们的架构设计里,根本就没有给人留“插手”的接口。

很多人第一反应是骂 AI 不行,骂算法愚蠢。但在我眼里,这不是 AI 的问题,这是架构设计的重大事故。

别把“无人化”当成终点

这几年,无论是做数字化转型的,还是搞 AI 落地的,嘴里挂着的最高频词汇就是“全自动”、“无人化”、“黑灯工厂”。仿佛只要系统里还留着一个人工审核的节点,就是落后,就是不够性感。

这种思维,典型的外行领导内行,或者是被资本故事洗了脑。

其实,任何系统都存在不确定性。传感器会噪声,网络会延迟,模型会幻觉。当一个系统宣称自己能 100% 处理所有情况时,它其实是在否认不确定性的存在。这违背了物理世界的基本规律。

全自动不是目标,可靠性才是。为了追求表面的“无人”,牺牲了系统的“鲁棒性”,这是本末倒置。

这个案例核心错误就在于把“自动化”等同于“闭环”。他们以为把流程跑通就是闭环,但实际上,真正的闭环必须包含“反馈修正”。在没有人工干预机制的情况下,系统的反馈回路是断裂的。一旦遇到训练数据之外的“边缘情况”(Edge Case),系统没有能力自我纠错,只能沿着错误的路径加速狂奔。

这不是技术能力的边界问题,是系统设计的逻辑漏洞。

那个翻车的系统,缺了一根“保险丝”

我们都知道电路里必须得有保险丝。电流过大时,保险丝熔断,保护整个电路不被烧毁。在人机协同的系统架构里,人,就是那根保险丝。

在那个翻车的案例里,我复盘了他们的技术栈。你会发现,他们的架构是典型的“开环控制”。输入指令,执行动作,结束。中间缺乏一个“观测 - 判断 - 决策”的校验层。

在传统工程控制论里,这叫缺乏负反馈机制。

人机协同不是让人去干机器能干的活,而是让人去处理机器处理不了的“异常”。

机器擅长的是高频、重复、确定性的任务。比如每秒处理一万条订单,比如识别图片里的猫还是狗。但机器不擅长的是什么呢?是理解上下文,是判断因果逻辑,是处理从未见过的突发状况。

当 AI 遇到一个它置信度只有 60% 的决策时,正确的架构设计应该是触发“人工介入机制”,把这个问题抛给人类专家。但在那家企业的系统里,阈值被强行设定为自动执行。为什么?因为管理层考核的是“自动化率”。为了 KPI 好看,他们把系统的“安全阀”给卸掉了。

这背后,是对技术边界的无知。他们以为买了一套先进的算法,就买断了所有的风险。殊不知,算法越强大,一旦出错,破坏力的放大效应就越显著。自动化不仅放大了效率,也放大了错误。

人机协同不是妥协,是架构必须

很多人把“人机协同”理解成一种过渡方案。觉得现在是 2026 年,先让人帮着干,等以后 AI 聪明了,人就可以滚蛋了。

大错特错。

人机协同不是权宜之计,它是智能系统长期稳定运行的架构必须。

从系统解耦合的角度来看,人和机器应该处于不同的层级。机器负责“执行层”,追求的是速度和精度;人负责“决策层”和“异常处理层”,追求的是判断力和责任感。

我们可以把这个架构想象成驾驶飞机。现在的客机自动化程度极高, 自动驾驶可以完成绝大部分飞行任务。但是,驾驶舱里永远必须坐着飞行员。为什么?不是为了让他们去拉操纵杆,而是为了在系统失效、天气突变、或者遇到恐怖袭击等非标准场景下,有人能站出来兜底。

数字化系统也是一样。我们需要构建一种“人在回路”(Human-in-the-Loop)的架构。

具体来说,怎么做?

第一,建立置信度阈值。系统输出的每一个决策,都必须带有一个置信度评分。高于 95% 的,自动执行;低于 95% 的,自动转入人工审核队列。这不是降低效率,这是风险控制。

第二,保留“紧急停止”按钮。无论自动化流程跑得多深,必须有一个物理或逻辑上的开关,能让人类管理员在几秒钟内切断自动执行权限。

第三,把人当成传感器。在系统设计中,人的操作不应该被视为“干扰”,而应该被视为“高价值数据”。当人工修正了 AI 的决策,这个修正动作本身就是一个标注数据,应该被回流到训练集,用来优化下一次的模型。

可以这样理解,人不是在给机器擦屁股,人是在给机器提供进化的养料。

重新定义你的“技术栈”

说到技术栈,大家想到的都是 Python、Java、TensorFlow、Kubernetes。但在数字化工程的视野里,这些只是工具。真正的技术栈,应该包含“人”这个节点。

如果一个系统的设计文档里,没有定义“人工干预接口”,没有定义“异常升级流程”,那这个设计文档就是不合格的。

很多CTO 跟我抱怨,说加上了人工审核,老板觉得不够“智能化”,预算不好批。这时候,你需要用工程语言去沟通。

你要告诉老板:我们不是在增加人力成本,我们是在购买“系统可用性”。

去掉人的系统,就像没有刹车的跑车,跑得越快,死得越惨。

我们可以算一笔账。全自动系统可能节省了 10 个人力成本,但一次重大事故造成的品牌损失、库存积压、客户流失,可能相当于这 10 个人十年的工资。这就是工程里的“风险溢价”。

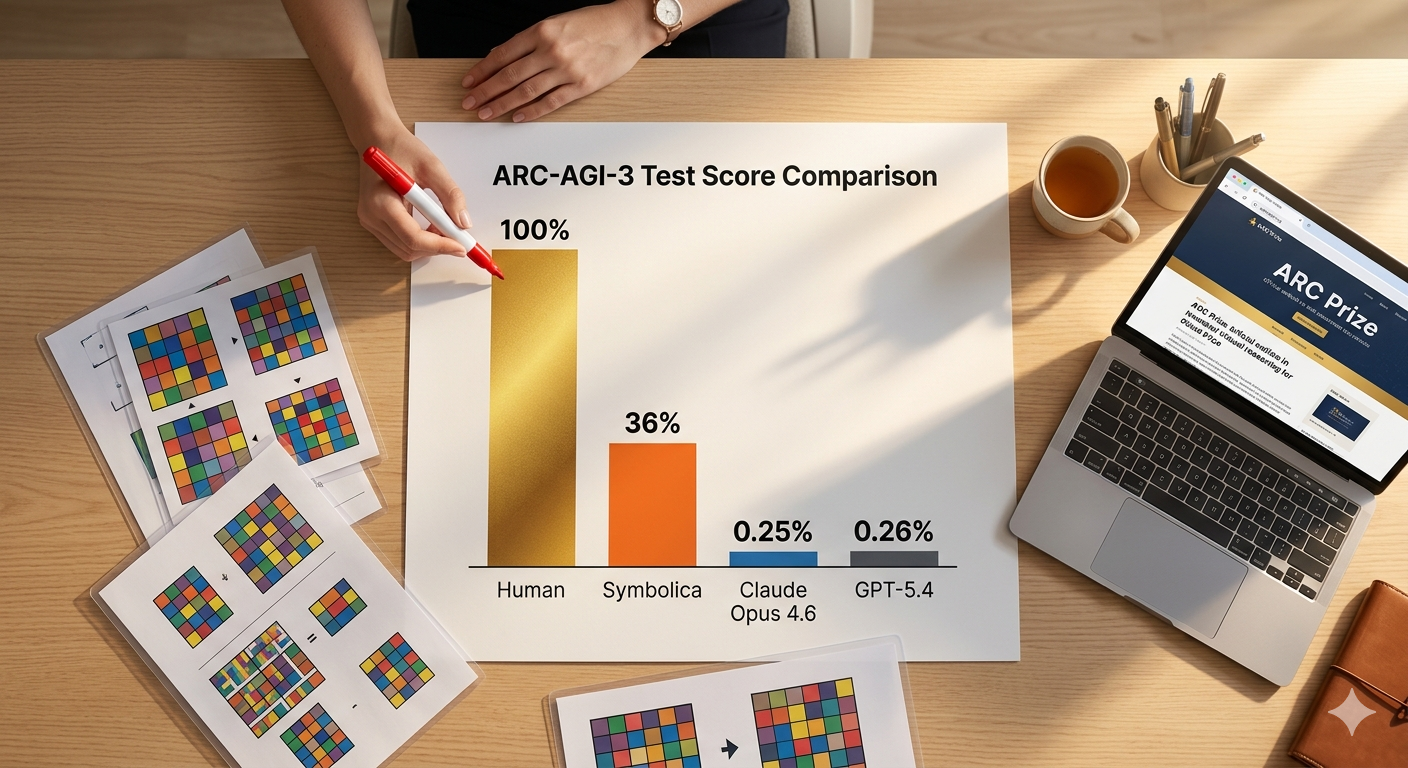

在 2026 年的今天,AI 已经足够强大,但它依然是一个概率模型。概率就意味着有失败的可能。对于非关键业务,失败可能只是 recommender 系统推荐错了一首歌;但对于关键业务,比如供应链、金融风控、医疗诊断,失败就是灾难。

所以,架构师的责任,就是识别哪些是关键业务,并在这些环节强行植入“人机协同”的锁扣。

别让用户为系统的傲慢买单

再往深了说,盲目追求全自动,其实是一种技术的傲慢。

这种傲慢体现在,系统设计者假设自己能预判所有场景,假设模型能理解所有人性。但现实世界是复杂的、混沌的、充满黑天鹅的。

当系统出错时,如果没有人工干预机制,最终承担后果的是谁?是用户,是客户,是基层员工。

那个电商案例里,最后背锅的是采购部经理,说是他没监控好系统。但问题是,系统根本没给他监控的权限。这就是典型的“权责不对等”。

好的工程伦理,是承认系统的局限性,并为这种局限性预留缓冲空间。

人机协同,本质上是一种谦卑。它承认机器不是神,承认人类经验在复杂系统中的不可替代性。它不是要阻碍技术进步,而是要让技术进步得更稳妥、更可持续。

我们见过太多这样的项目:起步时声势浩大,宣称要颠覆行业,全自动化上线;半年后问题频发,不得不偷偷加回人工客服;一年后系统被弃用,留下一地鸡毛。

为什么?因为他们违背了工程学的常识。他们试图用代码去穷举世界的复杂性,这是不可能的。

把选择权交还给合适的人

未来的数字化系统,不应该是一个封闭的黑盒,而应该是一个开放的、可协作的平台。

在这个平台上,AI 是副驾驶,人类是机长。AI 可以提供建议、预警、自动化执行常规任务,但最终的航向选择权,必须掌握在人手里。

这不仅仅是安全考虑,更是价值考虑。

人类的价值,不在于重复劳动,而在于创造性地解决问题。如果把人从系统里完全剔除,不仅增加了风险,也浪费了人类最宝贵的资源——判断力。

我们要做的,是把人从繁琐的执行中解放出来,让他们专注于更高维度的协同。比如,不再是人工去审核每一张发票,而是人工去定义审核的规则,处理那些规则之外的例外。

这才是人机协同的真谛。

工程是为人服务的,不是用来淘汰人的

最后,我想说点心里话。

我见过太多技术至上论者。他们眼里的世界是由代码和数据构成的,人只是一个容易出错的输入输出接口。

但在我看来,技术永远是手段,人才是目的。

这个案例的教训,不应该只被视为一个技术故障,它应该被视为一个行业警钟。它在提醒所有数字化从业者:不要迷信全自动,不要忽视人的价值。

真正的智能,不是机器取代人,而是机器赋能人。

当我们设计系统时,多问自己一句:如果系统错了,谁来救场?如果答案是没有,那么这个系统就是不合格的。

我们构建数字化系统,是为了让生活更美好,让工作更高效,而不是为了制造一个无法控制的怪物,让人类在其中失去立足之地。

保持敬畏,留有余地,让人回到系统的核心位置。这不仅是工程学的要求,更是技术伦理的底线。

技术是杠杆,人是支点。没有支点,杠杆再长,也撬不动地球,只会压垮自己。