你好,我是郑工长。

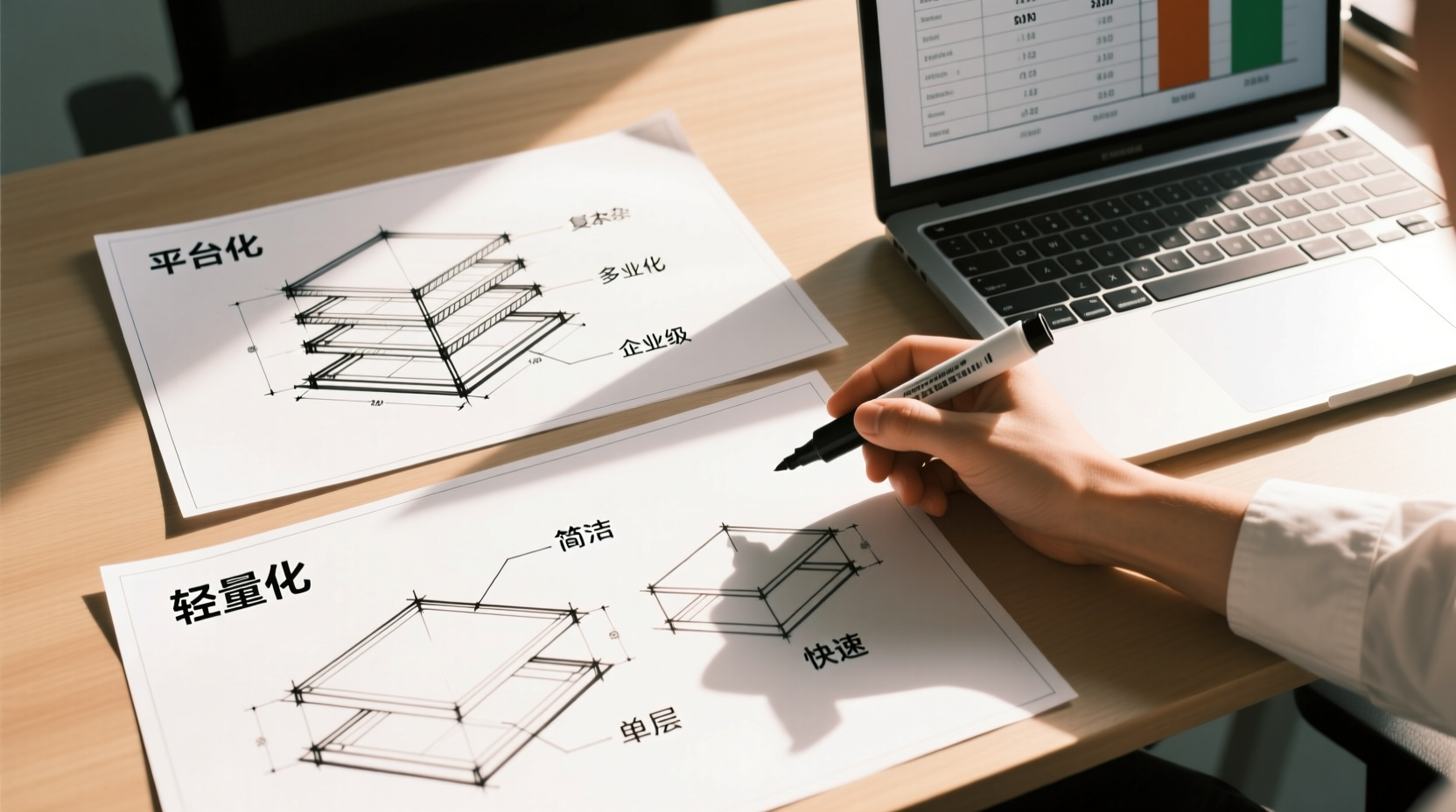

昨天和做产品的朋友聊天,他问我:“现在 AI Agent 到底是走平台化大路子,还是搞轻量化小工具?我看各家都在抢赛道,我这资源有限,怕选错了方向全盘皆输。”

我没直接回答他,而是问他:“你工地上是用塔吊多,还是用电钻多?”

他愣了一下。

说白了,这问题本身就是个伪命题。 很多人争论平台化还是轻量化,本质上是在争论“战略”,但从我们工程师的视角看,这完全是“架构选型”的问题。架构服务于场景,场景决定成本结构,成本结构决定生死。

今天我不聊那些虚头巴脑的市场预测,咱们把 AI 智能体拆开来看,从第一性原理出发,聊聊这背后的工程账。

别被 PPT 忽悠了,咱们看架构

现在的市场噪音太大,今天这个发布“超级智能体平台”,明天那个推出“一键生成 Agent"。你仔细想一下,这些宣传语背后,其实是在掩盖一个核心的工程难题:如何平衡“通用能力”与“特定场景效率”之间的矛盾。

一个标准的 AI 智能体,不管它叫什么名字,根子上都由四个模块组成:感知(Perception)、规划(Planning)、行动(Action)、记忆(Memory)。

平台化的思路,是想把这四个模块全部包圆了。它提供一个巨大的上下文窗口,内置几百种工具接口,试图让你在一个界面里解决所有问题。这听起来很美好,像是一个全能的生产力操作系统。

轻量化的思路,则是只做其中一个环节,或者只针对一个特定场景。比如专门用来写 SQL 的 Agent,或者专门用来整理会议纪要的 Agent。它可能就跑在你的本地,甚至只是一个浏览器插件。

记住这句话:任何脱离延迟(Latency)和成本(Cost)谈智能体架构的行为,都是耍流氓。

为什么我这么强调这两个指标?因为智能体不是单次对话,它是一个 Loop(循环)。一个复杂的任务,Agent 可能需要自我反思、调用工具、再反思、再调用。如果每次交互的延迟是 3 秒,平台化的大模型虽然聪明,但跑完一个流程可能要 5 分钟;轻量化的小模型虽然笨点,但响应只要 0.5 秒,跑完只要 30 秒。

在工程落地时,用户往往不在乎你有多聪明,只在乎你有多快。这就是为什么我一直强调,不要迷信大平台的“全能”,很多时候,快就是正义。

平台化的野心与包袱

咱们先说说平台化。大厂为什么喜欢搞平台?因为这是他们的基因使然。他们手里有算力,有数据,有生态,自然希望把用户锁在自己的围墙花园里。

从工程角度看,平台化最大的优势是鲁棒性(Robustness)。

当你把记忆、工具、模型都集成在一个闭环里时,接口是标准的,调试是可控的,出错率相对较低。比如某大厂推出的 Agent 平台,它内部的工具调用协议是统一的,不需要你去处理复杂的 API 鉴权、格式转换。对于企业客户来说,这意味着 SLA(服务等级协议)有保障,出了问题能找到人背锅。

可问题是,这种架构的边际成本太高了。

我干了这么多年,见过太多试图“大一统”的系统最后都变成了屎山。平台化 Agent 面临着严重的“耦合”问题。一旦平台方的模型更新,或者 API 策略调整,你上面构建的所有业务逻辑可能都要重构。

更重要的是,平台化往往意味着“过度设计”。你只是想让它帮你读个 PDF,它却非要调用一个复杂的知识库检索流程,还要经过层层安全过滤。这不仅增加了 Token 消耗,更致命的是增加了不可控的幻觉风险。

这背后,是商业利益与技术效率的博弈。平台想要的是你的数据留存和生态依赖,而你想要的是问题解决。

还有一个隐蔽的坑:隐私。平台化意味着你的所有操作日志、业务数据都要上传到云端。对于金融、医疗这些敏感行业,这简直是红线。我见过一个医疗项目,因为无法接受数据出域,最后不得不放弃某头部大厂的 Agent 平台,转而自建轻量级方案。

看看市场上的主流玩家都在怎么走:

🧱 平台化 Agent 代表产品(国际大厂):

OpenAI — OpenAI Agents / GPTs(企业级 Frontier Platform)

- 已支持工具、文件、API 集成、推理动作

- GPTs(个人版)、Agents(企业级)

- MCP(Model Context Protocol)协议推动互操作

→ 当前最典型的平台化路径

Amazon — Amazon Bedrock Agents

- Bedrock 上的"Agents for Amazon Bedrock"

- 原生集成 AWS 工具链

- 强 SLA、权限、合规控制

→ 最偏"企业级平台化"的方案之一

Google — Vertex AI Agents / Gemini Agent Framework

- 强 Workflow orchestration

- 调用企业知识库、数据仓库

- LLM + 企业云深度绑定

→ 更偏企业侧的完整 Agent 运行平台

Microsoft — Copilot Studio / Agentic Workflows

- Copilot Studio 能创建企业级 Copilot Agents

- 深度绑定 Office、Graph API、企业数据

→ "把微软生态变成一个大 Agent"

Anthropic — Claude Tools + Workflows(初步平台化)

- Claude 提供工具调用

- Workflows 进入可复用的结构化 Agent 模式

→ 正在从模型向平台演进

Perplexity — Computer / Perplexity Agent

- 自动执行搜索、推理、API 调用

- 自带 Action Agent

→ 自带"执行层"的搜索型平台 Agent

这些平台化方案的共同特点是什么?大而全,强绑定,高成本,高鲁棒性。 它们适合企业级客户,适合需要 SLA 保障的核心业务,但不适合快速试错和边缘场景。

所以,平台化不是不好,而是它适合“基建”,不适合“末端”。它适合做那个提供水电煤的公司,而不是那个直接给你修水管的师傅。

轻量级的刀锋与局限

反过来想,轻量化就完美吗?也不是。

轻量化的核心优势是解耦合(Decoupling)。

一个轻量级 Agent,通常专注于单一任务。比如就是一个本地运行的 Python 脚本,调用一个 7B 参数的小模型,专门用来处理 Excel 数据。它的启动速度快,隐私性好,而且最关键的是——便宜。

在成本敏感的场景下,轻量化是唯一的出路。你不可能为了每天自动整理一下发票,就去调用一次昂贵的云端大模型 API。这时候,本地部署的轻量化 Agent 就是最优解。

但是,轻量化有一个致命的弱点:上下文能力的缺失。

智能体的智能程度,很大程度上取决于它能“看到”多少信息。轻量化模型受限于显存和算力,上下文窗口通常较小,逻辑推理能力也弱。遇到复杂任务,它很容易“死循环”或者给出荒谬的结果。

我见过太多创业者拿着一个轻量级 Demo 去融资,说自己的 Agent 多么灵活。结果一上生产环境,遇到稍微复杂点的多步任务,直接崩盘。为什么?因为缺乏全局规划能力。

再看看轻量化阵营都有谁:

🧱 轻量化 Agent 代表产品(开源 / 本地 / 小团队):

OpenClaw(轻量化代表)

- 开源轻量框架

- 本地可跑、小模型可跑

- 工具调用、MCP、工作流

→ 典型的"轻量入口、灵活扩展"风格

LangChain Agents(开源)

- 完整 Agent 组合框架

- 自由度高

- 依赖开发者自行部署工具链

→ 最受开发者欢迎的轻量方案之一

AutoGPT / BabyAGI / SuperAGI(早期轻量 Agent 系列)

- 自主循环型 Agent(Loop Agent)

- 可调用工具、执行任务

→ 已不算前沿,但仍是轻量框架雏形

LlamaIndex Agents

- 长于文档处理

- 结合小模型即可运行

→ "知识驱动"轻量 Agent 的代表

AnythingLLM(本地 Agent Hub)

- 本地跑 LLM + 本地知识库

- 可接小模型

→ "轻量化本地 AI 助理"的典型代表

Ollama + 本地 Agent Frameworks(组合式轻量路径)

- Ollama 运行 7B/13B 本地模型

- 搭配各种轻量 Agent 框架(如 crewAI)

→ 典型本地隐私友好路线

crewAI(轻量多 Agent 协同框架)

- 多 Agent 协同

- 轻量化、开发者友好

→ 在技术圈流行的轻量工具

Mozilla — llamafile

- 模型一键运行,极简部署

→ 轻量化 Agent 的工具级组件

- 模型一键运行,极简部署

这些轻量化方案的共同特点是什么?快、便宜、解耦、隐私友好,但复杂任务能力不足。 它们适合开发者、个人用户、创业者,适合快速验证和特定场景,但需要自己处理集成和运维。

等等,事情没这么简单。轻量化的未来,不在于模型本身,而在于“连接”。

如果一个轻量级 Agent 能够像乐高积木一样,随时调用外部的专业能力呢?比如本地负责交互和隐私,遇到复杂推理时,无感切换到云端大模型,处理完再切回来。这种“混合架构”才是轻量级的进化方向。

但这就引入了新的工程挑战:状态管理。如何在本地和云端之间保持会话状态的一致性?如何处理网络波动带来的中断?这些都是要交过学费才懂的坑。

真正的战场不在模型,在协议

聊到这里,你可能觉得我在和稀泥。其实不是,我想指出的一个关键点是:未来的胜负手,不在模型大小,而在协议标准。

无论是平台化还是轻量化,最终都要面对一个问题:Agent 之间怎么说话?Agent 怎么调用工具?

现在的情况是,每家平台都有自己的协议。A 平台的 Agent 调不了 B 平台的工具,本地运行的 Agent 连不上云端的数据库。这就形成了新的“数据孤岛”。

从工程学角度看,这是典型的“互操作性”缺失。

我认为:谁定义了 Agent 之间的通信协议,谁就掌握了下一代的操作系统。

就像当年的 TCP/IP 协议统一了互联网,HTTP 协议统一了 Web 一样。AI 时代,我们需要一个统一的 Agent 交互协议。现在业界已经在尝试,比如 MCP(Model Context Protocol)之类的标准,但还不够成熟。

如果这个协议成熟了,平台化和轻量化的界限就会模糊。

你可以拥有一个轻量化的本地入口,但它背后连接的是整个互联网的服务能力。你不需要关心这个能力是来自哪个平台,只要协议通,就能调用。这时候,平台就变成了“服务提供商”,而轻量化变成了“用户终端”。

这才是真正的解耦。平台不再试图控制用户,而是通过提供高质量的服务接口来获利。用户不再被锁定,而是可以自由组合不同的 Agent 来完成工作。

对于开发者来说,这意味着机会。你不需要再去造一个大平台,你只需要做一个最擅长的“技能节点”,接入标准协议,就能被全球的 Agent 网络调用。

工程师的终极账本

最后,咱们算算经济账。

很多老板喜欢问:“这个 Agent 能省多少人?”

我的回答通常是:“别想着省人,先想着能不能跑通。”

平台化方案,初期投入低,因为不用自建基础设施,但长期来看,Token 费用和 API 调用成本是随着业务量线性增长的,甚至指数增长。一旦业务规模大了,这笔钱非常可观。

轻量化方案,初期投入高,你需要买显卡、做运维、调优模型,但边际成本极低。跑一次的成本可能就是几分钱电费。

所以,选择哪种架构,取决于你的业务规模和对数据的控制欲。

如果是初创团队,验证 MVP(最小可行性产品),平台化是首选。快上线,快试错,别在基础设施上浪费时间。

如果是成熟业务,尤其是涉及核心数据、高频调用的场景,轻量化或者混合架构是必然选择。这时候,可控性比便利性更重要。

我见过太多公司,一开始为了省事用平台,后来数据量大了,被厂商卡脖子,想迁移都迁移不了。这种技术债务,最后都要连本带利还回去。

归根结底,技术架构没有优劣,只有适不适合当下的生存环境。

不要为了追求所谓的“先进”而盲目上平台,也不要为了所谓的“自主可控”而硬啃轻量化。作为工程师,我们的职责是在约束条件下寻找最优解。

现在的 AI 智能体市场,就像当年的移动互联网早期。有人在做 iOS 封闭生态,有人在做 Android 开放联盟。最后赢了的,不是最封闭的,也不是最开放的,而是最能平衡体验与效率的。

对于大多数从业者来说,我的建议很明确:保持轻量化的入口,保留平台化的退路。

做一个能独立运行的小工具,但预留好接入大平台的接口。让数据留在本地,让算力弹性调用。这样无论风向怎么变,你都有转身的余地。

技术浪潮总会退去,裸泳的人会被看见,但穿好救生衣的人,永远能游到彼岸。在这个大分裂的时代,别赌谁胜出,要赌自己能活多久。

真正的护城河,不是你用了多大的模型,而是你的业务逻辑与架构解耦得有多干净。