你好,我是郑工长。

最近有个数据在圈子里炸开了锅:中国 AI 大模型的调用量首次超过美国,达到了 4.12 万亿 Token。很多人看到这个数字,第一反应是“中国 AI 崛起了”,或者反过来想,“这是不是又在刷数据?”

对于这种宏观数据,我的习惯是先不站队,而是从工程学的视角去拆解它。4.12 万亿 Token,这不仅仅是一个统计数字,它代表的是实际运行在生产环境里的负载。

其实,训练算力决定了一个模型的上限,但推理调用量决定了它的下限和生存能力。美国在基础模型训练上的投入确实领先,那是“造引擎”的能力;但中国现在的调用量反超,说明我们在“修高速”和“跑车”这件事上,已经跑出了规模。

训练是科研问题,推理是工程问题。调用量反超,标志着 AI 竞争的重心从“实验室性能”正式转向“工业化落地”。

仔细想想,这个转折意味着什么?以前我们聊 AI,聊的是参数量、是 benchmark 分数、是谁家的模型更聪明。现在聊的是调用量,聊的是谁家的模型被真正用到了业务流里。这就好比以前大家比谁的发动机理论功率大,现在比的是谁的车 actually 跑在路上拉的货多。

这背后,是应用生态的差异。

美国造引擎,中国修高速

为什么调用量会在中国率先爆发?这不是偶然,是产业结构决定的。

美国的科技巨头,习惯做底层基础设施。他们喜欢把模型做得极强,然后开放 API,等着开发者来用。这是一种“技术驱动”的逻辑,假设只要我工具足够好,你们自然能找到用法。这没错,但太慢了。

中国的打法不一样。我们是“场景驱动”。不管模型是不是最聪明的,只要能解决当下的业务痛点,能嵌入到现有的 APP、小程序、ERP 系统里,那就立刻上。

我见过太多项目,在美国可能还在争论伦理边界、还在做安全对齐的最后一轮测试,在中国,这个模型已经被接入了客服系统、代码助手、甚至电商导购里了。这种野蛮生长的能力,是工程师最熟悉的节奏。

工程学的核心不是追求完美,而是在约束条件下寻求最优解。中国 AI 的优势,在于对“约束条件”的极致适应。

这里的约束条件是什么?是成本、是延迟、是业务兼容性。

国内的大模型厂商,为了抢占有量,把 API 价格打到了地板价。几分钱一百万 Token,这让很多企业敢于尝试。以前做个 AI 功能,老板要算 ROI(投资回报率),算不过来就不做。现在成本低了,试错成本低了,调用量自然就上来了。

但这是否意味着我们赢了?别搞错了。调用量高,不代表技术壁垒高。如果这 4.12 万亿 Token 里,大部分是用来写写废话、聊聊天、生成些无关紧要的文案,那这个数据的含金量就要打折。

真正的考验在于,这些调用有多少是发生在核心业务链路里的?有多少是替人类做了真正的决策?

调用量背后的工程账本

我得跟大家算算这笔账。

调用量上去容易,稳住难。4.12 万亿 Token 的背后,是巨大的并发压力。想象一下,如果这些调用集中在早晚高峰,对服务器集群的弹性伸缩能力、对推理引擎的优化能力,都是极大的考验。

很多初创公司,Demo 做得漂亮,一上生产环境就崩。为什么?因为没做过压力测试,没考虑过显存碎片化,没处理好上下文窗口的内存管理。

鲁棒性(Robustness)是区分玩具和产品的分水岭。能在高并发下保持低延迟、高稳定的服务,才是真本事。

现在国内的大模型厂商,其实都在补这一课。如何降低首字延迟(TTFT)?如何做量化推理而不损失太多精度?如何设计缓存机制来减少重复计算?这些都是硬功夫。

我再说一遍,别只盯着模型智商看。在工程落地阶段,稳定性比智商更重要。一个偶尔胡说八道但响应快的模型,在某些场景下比一个思考半天但永远正确的模型更有价值。为什么?因为用户体验是连续的,中断的成本太高。

这里就涉及到一个“解耦合”的问题。

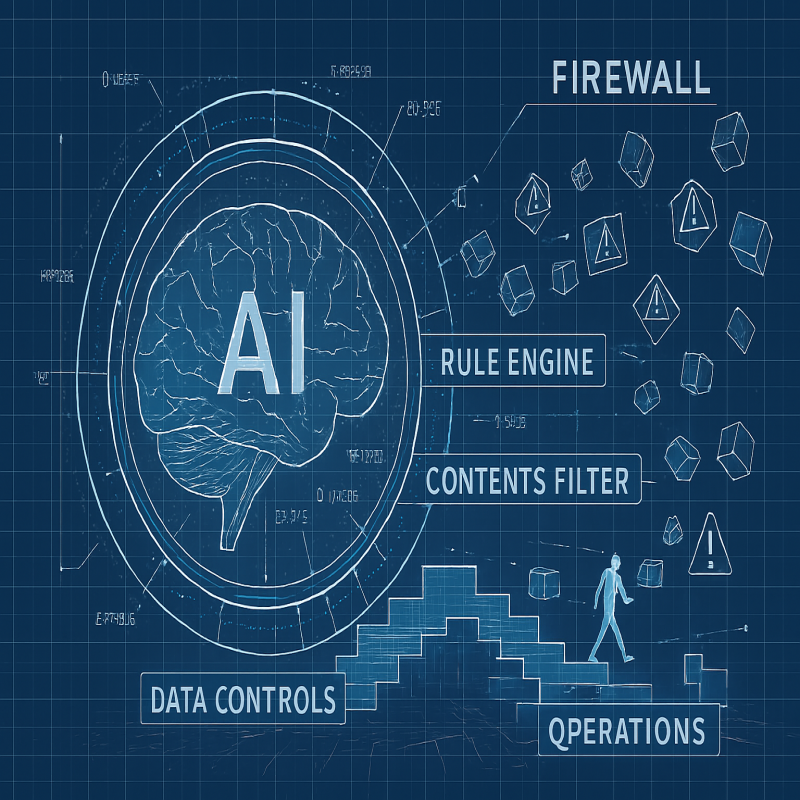

很多开发者把大模型当成万能药,什么逻辑都塞给模型去处理。这是大忌。正确的架构应该是:传统代码处理确定性逻辑,大模型处理非确定性生成。把两者解耦,才能控制好成本和风险。

如果这 4.12 万亿 Token 里,有大量是因为架构设计不合理,导致把简单的分类任务也扔给大模型去做,那这是一种浪费。真正的工程高手,会设计一个路由层,简单问题小模型解,复杂问题大模型解,甚至不需要模型就能解。

所以,调用量第一,既是荣誉,也是压力。它意味着我们的系统正在承受真实的流量冲刷,这也暴露问题的最佳时机。

下一场仗,不在模型在场景

话说回来,数量超过了,质量怎么跟?

这就到了我最想强调的部分。未来的竞争,不在基座模型本身,而在基于模型的 Agent(智能体)和工作流。

现在的大模型调用,大部分还是“一问一答”的模式。用户输入,模型输出。这种模式太浅了。真正的价值,在于模型能够调用工具、能够规划任务、能够与其他系统交互。

单纯的对话是消费,基于工作流的调用才是生产。

举个例子,调用模型写一封邮件,这是消费 Token。调用模型读取邮件内容、分析意图、查询数据库、生成回复草案、甚至直接发送,这是生产流程。后者的 Token 含金量,是前者的十倍。

中国拥有世界上最复杂的数字化应用场景。从电商到物流,从制造到政务,这些场景里沉淀了大量数据,也积累了大量痛点。

我见过太多企业,手里握着数据金矿,却不知道怎么挖。大模型调用量的上升,说明大家开始尝试挖了。但怎么挖得深、挖得准,才是接下来的关键。

这里有个趋势很明显:垂直化。

通用大模型什么都懂一点,但什么都不精。在医疗、法律、工业质检这些领域,需要的是经过微调的、带有行业知识图谱的专用模型。未来的调用量增长,会越来越多地来自这些垂直领域。

这话我放这儿:谁能把大模型真正嵌入到企业的 ERP、CRM、MES 系统里,让 AI 成为业务流程的一个无感环节,谁就能守住这 4.12 万亿 Token 带来的红利。

反之,如果只是做个套壳聊天机器人,靠补贴换来的调用量,迟早会退潮。

别被数字迷了眼,要看落地生根

我们得清醒一点。调用量超过美国,是一个里程碑,但不是终点。

在工程界,我们常说“上线只是开始”。模型调用的规模效应,会带来新的问题。比如数据隐私怎么保护?比如生成内容的合规性怎么控制?比如长期运行的成本怎么优化?

这些问题,没有现成的答案,都需要我们在实践中摸索。

我干了这么多年,交过学费才懂一个道理:技术本身没有护城河,技术应用形成的生态才有。

美国有英伟达的硬件生态,有开源社区的文化生态。我们有应用场景的生态,有快速迭代的工程生态。这两种生态没有绝对的高下,只有适不适合。

现在的情况是,我们的应用生态跑起来了,但底层的硬件和框架还受制于人。这是一个隐患。如果底层算力卡脖子,上层的调用量再大,也是建立在沙滩上的城堡。

所以,我们在为调用量高兴的同时,更要关注底层技术的自主可控。这不是喊口号,是生存问题。

技术栈的独立性,决定了应用层的可持续性。

未来的几年,会是洗牌期。那些只靠烧钱换调用量的公司会倒下,那些能真正通过 AI 降本增效、创造新价值的公司会留下来。

对于开发者来说,这意味着机会。不要再去卷基座模型了,那是巨头的游戏。去卷应用,卷场景,卷工程优化。去研究怎么让 Token 用得更省,怎么让响应更快,怎么让结果更准。

工程人的浪漫是解决问题

最后,我想说点心里话。

作为工程师,我们当然希望国家的技术实力越强越好。但比起宏观的胜负,我更关心的是,这 4.12 万亿 Token 背后,有多少是真正解决了人的问题。

是有多少医生用它辅助了诊断?有多少工人用它优化了流程?有多少孩子用它得到了更好的辅导?

如果这些调用量,只是变成了互联网上的垃圾信息,变成了无效的内耗,那这个第一,不要也罢。

但如果这些调用量,代表了生产效率的真实提升,代表了人类与机器协作的新常态,那这才是我们追求的“第一”。

归根结底,技术的价值不在于它有多先进,而在于它有多有用。

中国 AI 现在的势头,很像当年的移动互联网。那时候我们也曾被质疑只会做应用,不会做底层。但结果呢?我们创造了世界上最丰富的移动生态。

现在历史可能在重演。我们可能在基础理论上暂时落后,但在将技术转化为生产力的能力上,我们正在建立新的壁垒。

这不需要盲目自大,也不需要妄自菲薄。只需要一个个项目去啃,一行行代码去写,一个个 Bug 去修。

真正的领先,不是看谁的声音大,而是看谁的机器转得稳,看谁的系统在深夜里依然能可靠地响应每一次请求。

时间会证明,那些在工程细节上死磕的人,那些在场景落地中摸爬滚打的人,才是这个时代的脊梁。调用量只是一个开始,真正的故事,藏在每一次成功的推理背后,藏在每一个被 AI 优化过的真实工作流程里。

别搞错了,我们不是为了刷数据而存在,我们是为了解决问题而存在。当 4.12 万亿 Token 变成 4.12 万亿次价值的交付,那才是我们真正超越的时候。