你好,我是郑工长。

过去两年,AI圈的主旋律就一个字:大。更大的参数、更强的算力、更多的数据,我们用“大力出奇迹”的方式,暴力破解了通用智能的门槛。但如果你还认为这就是AI的全部未来,那可就大错特错了。

风向,已经变了。

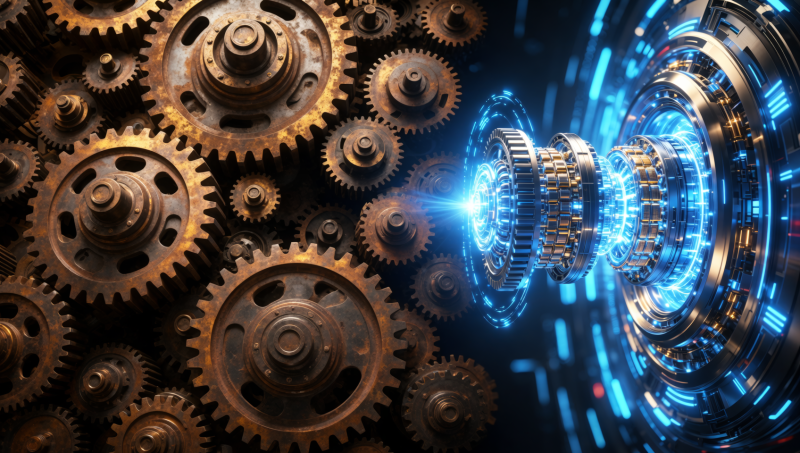

这背后,是一个所有工程领域都遵循的铁律:任何系统的发展,都会从“野蛮生长”阶段,过渡到“优化集约”阶段。AI的“摩尔定律”正在失效,真正的壁垒不再是堆砌资源,而是算法与架构的“巧劲”。

说白了,AI的上半场是“体量战争”,比的是谁更“大”;而下半场,则是“密度战争”,比的是谁的“智能密度”更高。

什么是“智能密度”?

简单来说,就是在同等或更少算力、更少数据的情况下,实现更高性能、更强能力。它衡量的是一个模型的“效率”和“性价比”。

为什么现在“密度”变得如此重要?

- 成本触顶: 训练一个万亿级模型的成本高达数千万甚至上亿美元,能源消耗更是惊人。这种“军备竞赛”模式,除了少数巨头,谁也玩不起。成本,是倒逼行业冷静下来的第一座大山。

- 边际效应递减: 单纯增加参数规模,带来的性能提升越来越有限。就像一辆车,发动机从100马力提升到500马力感觉明显,但从5000马力提升到10000马力,你可能已经感觉不到区别了,但成本却在飙升。

- 应用落地需求: 真正的商业价值,来自于能部署在手机、汽车、工厂里的AI,而不是只能待在数据中心里的“巨兽”。端侧设备对模型的体积和能耗有严格限制,高密度的小模型才是刚需。

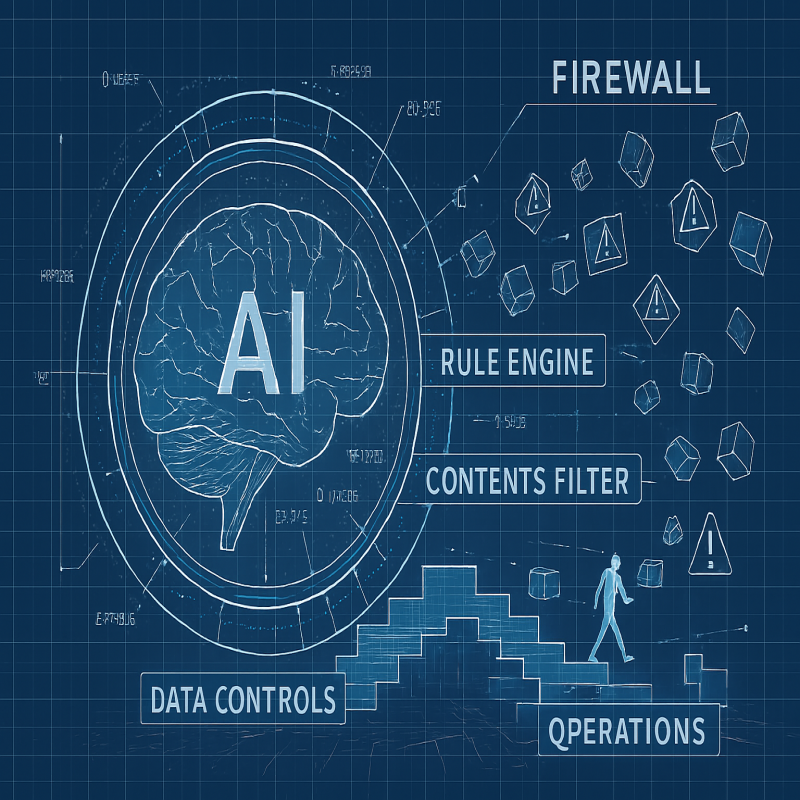

“密度战争”怎么打?

这不是简单的模型压缩,而是从算法、架构到训练方法的全面革新。

- 更优的架构: 比如最近热门的混合专家模型(MoE),它不是在运行时调动整个大模型,而是像一个专家团队,根据问题只激活最相关的“专家”,大大降低了推理成本。

- 更高质量的数据: 从“数据投喂”转向“数据精炼”。用更少、但质量更高、更多样化的数据,训练出更聪明的模型。

- 更高效的算法: 在模型训练和推理算法上持续创新,找到更优的数学解法。

对于我们从业者和公司而言,“密度战争”是一个巨大的机会。它意味着,未来AI领域的竞争,不再仅仅是巨头们的资本游戏。拥有绝佳算法、精巧架构、或高质量独家数据的“小团队”,完全有机会通过“高密度”模型,在垂直领域实现对“大而笨”模型的“降维打击”。

所以,别再只盯着GPT-5的参数又涨了多少万亿了。真正的变革,正发生在那些你看不到的、关于“密度”的战场上。你,准备好打这场效率之战了吗?